AMD presenta sus nuevos procesadores Epyc para servidores en un evento bajo techo en San Francisco. Epyc 98×4 basado en Zen 4c «Bergamo» tiene hasta 128 núcleos que incluyen subprocesos múltiples simultáneos, por lo que proporciona hasta 256 subprocesos. Genoa-X, como el Epyc 9684X, tiene hasta 1125 GB de caché L3.

Los procesadores Epyc Bergamo y Genoa-X son compatibles con la misma plataforma Genoa y se pueden ejecutar después de actualizar el BIOS. Esto permite a los clientes mezclar y combinar fácilmente sus servidores en rack cuando ejecutan diferentes cargas de trabajo.

Los AMD Epycs existentes ahora también se utilizan para obtener una vista previa de las instancias EC2 M7a en Amazon AWS Cloud. Debería alcanzar un rendimiento un 50 % superior al de M6a con Epycs anteriores y ser las instancias x86 más rápidas de la gama de Amazon. Oracle Cloud quiere hacer lo mismo con las instancias E5 a partir de julio. Microsoft también quiere que Genoa-X se use inmediatamente en instancias HBv4/HX en su nube de Azure y promete un salto de rendimiento en comparación con HBv3 con Milan-X hasta un factor de 5,7 en NASTRAN, una aplicación para simulación que utiliza método de elementos finitos.

Los procesadores Genoa actuales ya se desempeñan muy bien en comparación con los procesadores Xeon de Intel, y AMD se ve un 90% por delante en AMD SPECpower_ssj 2008, particularmente en términos de eficiencia energética. Estos socios de la nube también valoran la alta eficiencia energética, ya que reduce los costos operativos.

Además del Epyc 9004 regular (consulte más abajo los detalles sobre la tecnología), AMD ahora también vende sucursales especializadas en Bergamo y Genoa-X. Para telecomunicaciones y aplicaciones de gama alta, Siena se agregará en la segunda mitad de 2023 con más mejoras especiales. Sin embargo, AMD todavía guarda silencio al respecto.

Epyc 97×4: Rapid Bergamo con 256 CPU

El núcleo 4c, incluido el caché L2, es aproximadamente un 35 por ciento más pequeño que el Zen 4

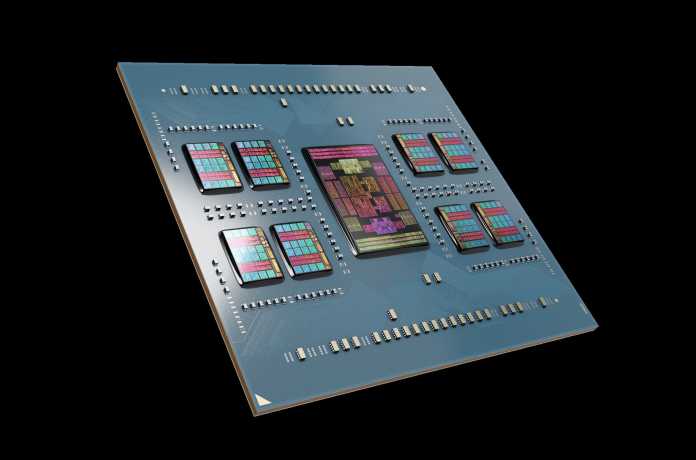

Bergamo es un Génova revisado y por lo tanto tiene un Zen 4 núcleos. Sin embargo, AMD ha mejorado el diseño de circuitos en estos núcleos Zen 4c y ha aumentado considerablemente la densidad de celdas utilizadas. Los diseñadores de chips ahora pueden integrar 32 núcleos en lugar de los 16 núcleos anteriores en un chip de cómputo de caché (CCD). Sin embargo, el caché L3 permanece en 32 MB. Cada bloque de 16 MB pertenece a una partición de 16 núcleos (CCX), como en las generaciones anteriores de Zen, hay dos particiones CCX por CCD que se comunican entre sí a través de Infinity Fabric en lugar de hacerlo directamente. Esto simplifica el diseño de caché L3 y permite una mayor densidad de transistores, pero reduce la latencia cuando los datos deben pasar de un CCX a otro. En Bérgamo se han instalado un total de 82 mil millones de transistores.

Bergamo utiliza núcleos 4c Zen optimizados para rendimiento por vatio.

(Imagen: AMD)

En términos de rendimiento, AMD afirma tener la CPU de servidor más rápida con Bergamo y su 128 Zen 4c en lo que respecta a los valores de referencia de CPU SPECrate 2017 en el sistema int_base, es decir, cálculos correctos con un conjunto limitado de optimizaciones. Un solo Epyc 9754 debería lograr 981,4 puntos, un sistema 2P 1950. Con la misma potencia de diseño térmico de hasta 400 W, dependiendo de la carga de trabajo, los dispositivos Bergamo Epyc pueden funcionar de manera más eficiente que el conocido Epyc 9004.

AMD ve Bergamo-Epyc 97×4 principalmente en centros de datos en la nube, donde, por ejemplo, muchas máquinas virtuales se ejecutan en paralelo con un conjunto de núcleos fijos. Con el Epyc 97×4, la compañía quiere mantener bajo control los procesadores de servidores ARM, pero también el Altra Max de Ampere, que también tiene 128 núcleos, o los próximos 192 con tecnología RISC-V de la startup estadounidense Ventana Micro. AMD solo puede anunciar Bergamo con la mayor cantidad de procesadores lógicos o CPU virtuales por versión, porque a diferencia de los servidores ARM o RISC-V, Bergamo domina el subprocesamiento múltiple concurrente (SMT) y proporciona al sistema operativo dos núcleos virtuales para cada núcleo físico. Esto permite una mejor compensación por la latencia de la memoria y la utilización de unidades aritméticas. Sin embargo, algunos proveedores de nube no usan SMT por razones de seguridad, porque SMT facilita algunos ataques de canal lateral.

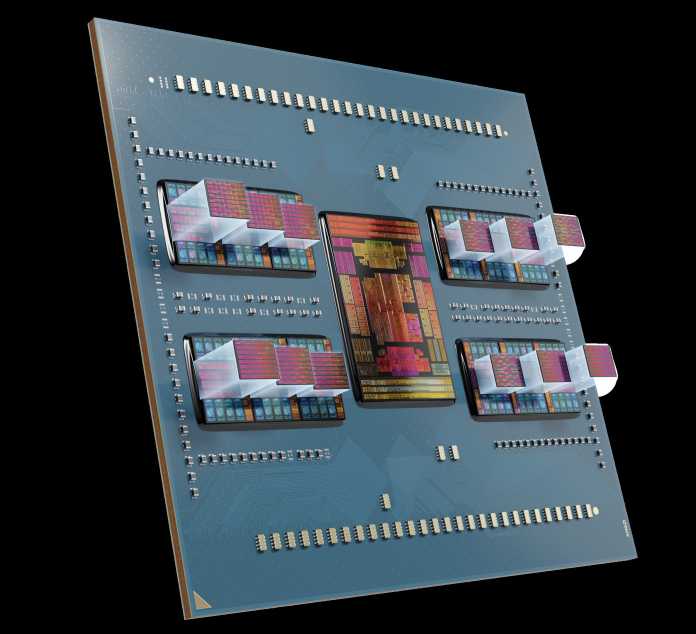

Génova-X con mucho caché

La tecnología 3D o V-Cache de AMD hizo su debut en la generación anterior de CPU de servidor Milan-X y Epyc 7xx3X. Se vuelve a utilizar en el modelo Génova y amplía la memoria caché L3 para cada uno de los doce CCD de 32 a 96 MB. La CPU puede acceder a un máximo de 1152 MB de caché L3.

AMD Epyc 9004: caché L3 aumentada a 1125 GB con módulos 3D V-Cache adicionales.

(Imagen: AMD)

No todas las aplicaciones se benefician por igual de los grandes cachés; AMD ve a Genoa-X principalmente en cálculos técnicos, como diseño de productos, análisis estructural, aerodinámica u otras simulaciones. No reemplaza al Epyc 9004 regular, pero se ofrece como complemento. Debido a la gran memoria caché, algunas aplicaciones tienen que ejecutarse hasta el doble de rápido, lo que también duplica la productividad de cada día laboral. Esto no solo hace posible crear sistemas de servidores más rápidos, sino también más eficientes energéticamente.

Según AMD, el Epyc 9964X de gama alta debería superar al Intel Xeon Platinum 8480+ y también al 8490H de 60 núcleos en dichas aplicaciones. AMD mismo habla de un factor de 2.2 (eso es un 120 por ciento más) con OpenFOAM hasta 2.9x en Ansys Fluent. La tecnología V-cache de AMD utiliza ranuras pasantes de silicio (TSV), es decir, conexiones verticales a través de la matriz, para conectar otro chip de silicio con una caché optimizada para la región por encima de la caché normal de nivel 3 de 32 MB en Génova.

La tecnología de apilamiento de TSMC permite una densidad de contacto extremadamente alta y no requiere conexiones soldadas. En cambio, los chips se colocan directamente uno encima del otro con conexiones directas de cobre. Según AMD, el chip de caché adicional no requiere ninguna lógica adicional como etiquetas L3 o similares; Por lo tanto, se puede construir de forma más compacta. Por lo tanto, ocupa 64 MB en lugar de los 32 MB adicionales por chip.

Tecnología Zen4

El Epyc 9004 de la versión SP5 tiene núcleos de CPU de generación Zen 4, que se han mejorado en comparación con Zen 3. Debido a la tecnología de microproducción TSMC N5 en lugar de N7, hay el doble de caché L2: 1 MB por núcleo en lugar de los 0,5 MB de bytes anteriores . La caché L3 se mantuvo en 32 MB por cada ocho núcleos, que se ubican juntos en un núcleo complejo (CCD). Al igual que los Xeon de Intel, los núcleos Zen 4 ahora procesan instrucciones AVX-512, instrucciones de red neuronal vectorial (VNNI) y formato de datos BFloat16 (BF16) para algoritmos de IA.

Mientras que los Xeon más potentes (pero no todos) tienen cada uno dos unidades de cómputo AVX-512 por núcleo de CPU, AMD agrupa dos unidades de cómputo AVX2 para el AVX-512. Con la misma frecuencia de reloj, el núcleo Xeon puede procesar el doble de instrucciones AVX-512 que el núcleo Epyc. Sin embargo, dado que los Xeon se registran en menos tiempo al procesar el código AVX-512 que otro código, el beneficio no es tan grande.

Genoa-IOD no solo tiene más enlaces Infinity Fabric y más rápidos para dispositivos CCD, sino que también proporciona velocidades de transferencia de datos mucho más altas a la memoria (RAM) y PCI Express (PCIe). Porque en lugar de los ocho canales anteriores de memoria DDR4-3200, ahora hay doce canales para DDR5-4800 y, por lo tanto, una tasa de transferencia de datos un 125 por ciento más alta de 460 en lugar de 204 GB/s.

64 de las 128 ranuras PCIe también son compatibles con Compute Express Link (CXL). Esto permite que los aceleradores informáticos se comuniquen de forma coherente con la memoria caché, lo que aumenta la eficiencia: los datos no tienen que copiarse de un lado a otro con tanta frecuencia. Lo que es aún más importante con Epyc 9004 es que CXL también puede conectar módulos DRAM adicionales y SSD ultrarrápidos con funciones especiales, como memoria de clase de almacenamiento (SCM) y almacenamiento computacional.

(csp)

«Erudito en viajes incurable. Pensador. Nerd zombi certificado. Pionero de la televisión extrema. Explorador general. Webaholic».